Ho integrato LLM nei flussi di lavoro esistenti senza riscrivere tutto da zero

Integrare i LLM nei flussi di lavoro esistenti non richiede una completa riscrittura. Con gli strumenti giusti, puoi inserire potenti capacità AI mantenendo i tuoi sistemi attuali.

Integrare modelli linguistici di grandi dimensioni nei flussi di lavoro esistenti può essere realizzato senza una riscrittura completa. Di seguito sono elencati i migliori strumenti che ti permettono di inserire i LLM nei tuoi processi in modo rapido ed efficiente, ordinati per rilevanza e facilità d'uso.

LLM Prompt Saver eccelle perché trasforma una semplice estensione del browser in un potente repository di prompt. Con un solo clic puoi memorizzare, modificare e riutilizzare prompt per decine di LLM, mantenendo il tuo flusso di lavoro in un unico posto. Gestione delle prompt senza interruzioni facilita l'integrazione in qualsiasi sistema esistente.

Ideale per sviluppatori individuali o team che desiderano accesso immediato ai prompt su più piattaforme. LLM Prompt Saver

LangTale offre uno spazio unificato per la collaborazione sui prompt, consentendo ai team di lavorare insieme sulla stessa base di prompt. L'interfaccia intuitiva e l'editing in tempo reale aiutano a prevenire silos e accelerano la iterazione. Modifica collaborativa dei prompt è il vantaggio principale.

Ideale per team remoti che necessitano di un'unica fonte di verità per le interazioni con i modelli. LangTale

LLime crea assistenti AI personalizzati su misura per i flussi di lavoro aziendali, integrandoli nello stack tecnologico esistente senza modifiche di codice estese. Apprende continuamente dai feedback, migliorando le prestazioni nel tempo. Assistenti in continuo miglioramento mantengono il tuo caso d'uso fresco ed efficace.

Progettato per qualsiasi azienda che desideri integrare un assistente AI che cresce con i dati degli utenti. LLime

ReLLM aggiunge un contesto di lungo termine sensibile ai permessi alle tue applicazioni basate su LLM, abilitando filoni di conversazione continui senza gestione manuale dello stato. Controllando l'ambito della memoria, preserva la privacy mentre aumenta la rilevanza. Contesto a lungo termine è la caratteristica critica che lo differenzia.

Perfetto per ambienti con forti requisiti di conformità che necessitano di controlli granulari sulla conservazione dei dati. ReLLM

LiteLLM funge da gateway unificato che ti consente di indirizzare le richieste verso oltre cento LLM nel formato OpenAI familiare, eliminando il vendor lock‑in. Il suo strato API leggero rende rapido cambiare provider senza toccare il tuo codice. Gateway LLM universale ti garantisce flessibilità.

Ideale per sviluppatori che necessitano di esperimenti rapidi su più modelli. LiteLLM

LM Studio ti consente di sperimentare con i LLM open‑source di Hugging Face localmente, evitando costi e latenza cloud. Il supporto per linea di comando e GUI è adatto a principianti e utenti esperti, semplificando la curva di apprendimento. Esperimenti LLM locali mantengono i dati in sede.

Ottimo per ricercatori e sviluppatori che desiderano pieno controllo sul comportamento del modello. LM Studio

Semantic Kernel offre un framework orientato allo sviluppatore per incorporare funzionalità LLM avanzate in qualsiasi applicazione, dai microservizi alle app desktop. Astrae le complessità dell'ingegneria dei prompt, permettendoti di concentrarti sulla logica di business. Integrazione di livello enterprise è la chiave che accelera l'adozione.

Adatto a stack centrati su Microsoft che desiderano aggiungere funzionalità AI senza reinventare la ruota. Semantic Kernel

AI Docs automatizza attività centrali su documenti usando LLM e offre integrazioni via API, Telegram e bot WhatsApp, trasformando la gestione del contenuto di routine in un singolo flusso di lavoro. Il suo sistema di template accelera l’onboarding dei nuovi documenti. Automazione multi-canale garantisce comunicazioni coerenti.

Ideale per team di supporto e creatori di contenuti che necessitano di risposte rapide su più piattaforme. AI Docs

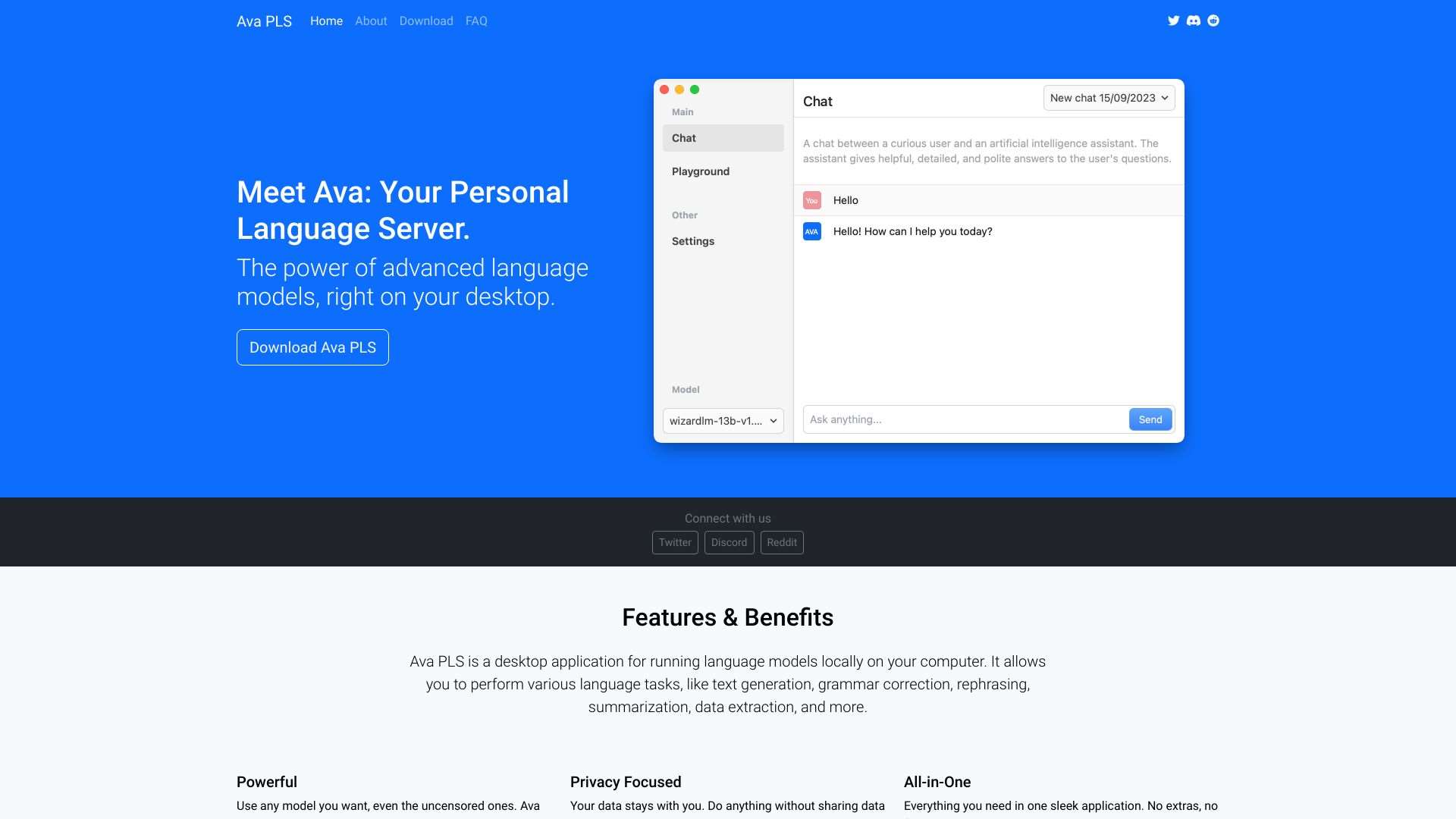

Ava PLS porta i modelli linguistici di grandi dimensioni sul desktop, offrendo un'interfaccia grafica intuitiva così che puoi eseguire potenti LLM offline senza dipendenze cloud. Facilita la migrazione per i team preoccupati per la privacy dei dati. Potenza LLM desktop produce risultati immediati.

Particolarmente utile per industrie sensibili ai dati che richiedono inferenza locale. Ava PLS

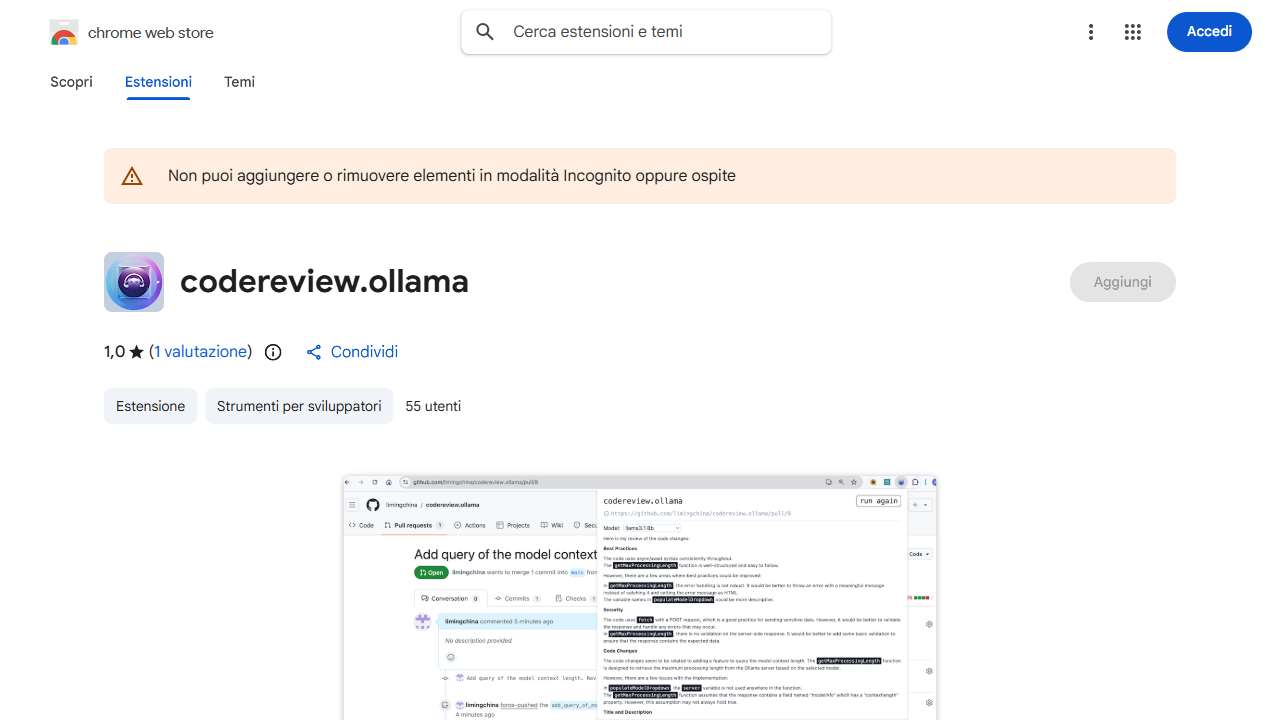

Revisione automatizzata del codice su GitHub e GitLab è resa facile con questa estensione Chrome alimentata da LLM che utilizza Ollama per analizzare le modifiche e suggerire miglioramenti. Integrandola nei pipeline CI, ogni PR ottiene feedback istantaneo guidato dall'IA. Revisione intelligente del codice migliora la qualità del codice.

Ideale per team di sviluppo che vogliono ridurre il carico di lavoro manuale nella revisione e individuare bug più rapidamente. Review Pull Requests on github or Merge Requests on gitlab with Ollama using LLMs

Utilizzando questi strumenti, puoi integrare l'intelligenza LLM nei tuoi sistemi attuali con pochi cambiamenti di codice, garantendo una transizione senza intoppi verso flussi di lavoro più intelligenti.